Intelligenza Artificiale e Google: le applicazioni AI nella Ricerca

Era il 2015 quando Google annunciò l’introduzione del primo sistema di intelligenza artificiale applicato alla Ricerca, ovvero RankBrain, e in questi anni il lavoro tecnologico è andato avanti, soprattutto per migliorare la comprensione della lingua e, di conseguenza, fornire in SERP risultati di ricerca più vicini alle reali esigenze delle persone, come abbiamo raccontato qualche giorno fa presentando gli ultimi sviluppi di LaMDA. Ora è proprio Google a fare il punto sullo stato di questa evoluzione e condividere informazioni su come l’IA applicata alla Ricerca “si traduce in risultati rilevanti”, e quindi dove e come sono davvero usati tali sistemi.

L’Intelligenza Artificiale nella Ricerca Google

È direttamente Pandu Nayak, Google Fellow e Vice President di Search, a descrivere in un approfondito articolo su The Keyword “in che modo l’IA fornisce ottimi risultati di ricerca”, aiutando Google a capire cosa l’utente sta cercando grazie al miglioramento della comprensione della lingua.

Prima del 2015 e comunque prima di disporre di un’intelligenza artificiale avanzata, i sistemi di Google “cercavano semplicemente le parole corrispondenti”, ricorda Nayak, che in particolare cita il caso delle misspelling: cercando pziza “a meno che non ci fosse una pagina con quel particolare errore di ortografia, probabilmente avremmo dovuto ripetere la ricerca con l’ortografia corretta per trovare l’informazione a cui eravamo interessati”. Nel tempo, però, Google ha imparato a codificare algoritmi per trovare classi di modelli, come errori di ortografia popolari o potenziali errori di battitura da chiavi vicine e ora, con l’apprendimento automatico avanzato, i suoi sistemi possono riconoscere in modo più intuitivo se una parola non sembra corretta e suggerire una possibile correzione.

Questi miglioramenti dell’AI ai sistemi di ricerca permettono di perfezionare costantemente la comprensione di ciò che l’utente sta cercando, un fattore determinante alla luce del fatto che “il mondo e le curiosità delle persone sono in continua evoluzione”, con “il 15% delle ricerche che vediamo ogni giorno che sono del tutto nuove”.

Le reali applicazioni dei sistemi AI

Negli stessi giorni è apparso anche un articolo di Barry Schwartz dedicato a questo tema, in cui si riportano le informazioni fornite dal public liaison Danny Sullivan, che rivela che – in sintesi – sono quattro le tecnologie attualmente in funzione nel sistema di Ricerca.

Per la precisione, RankBrain, corrispondenza neurale e BERT sono utilizzati nel sistema di ranking di Google in molte, se non nella maggior parte, query e cercano di comprendere il linguaggio della query e del contenuto che sta classificando. E poi c’è MUM, che per ora non è utilizzato per scopi di classifica, ma solo per la denominazione dei vaccini COVID e per alimentare gli argomenti correlati nei risultati dei video.

Quali sono le applicazioni AI in funzione su Google

Come spiega Nayak, non dobbiamo pensare che necessariamente una tecnologia più moderna mandi in pensione quella precedente: Google ha sviluppato centinaia di algoritmi nel corso degli anni sempre con l’obiettivo di fornire risultati di ricerca pertinenti, e oggi utilizza centinaia di algoritmi e modelli di apprendimento automatico che lavorano bene insieme, vecchi e nuovi. Questo perché “ogni algoritmo e modello ha un ruolo specializzato e si attiva in momenti diversi e in combinazioni distinte per aiutare a fornire i risultati più utili”, anche se inevitabilmente alcuni dei sistemi più avanzati svolgono un ruolo più importante di altri, come i 4 citati nell’articolo:

- RankBrain: un sistema di classificazione più intelligente

Si parte come detto da RankBrain, il primo sistema di deep learning applicato alla ricerca. A quel tempo, dice Nayak, “era rivoluzionario non solo perché era il nostro primo sistema di intelligenza artificiale, ma perché ci aiutava a capire come le parole si relazionano ai concetti del mondo reale“, che per gli esseri umani è un fatto istintivo, ma per un computer è una sfida complessa.

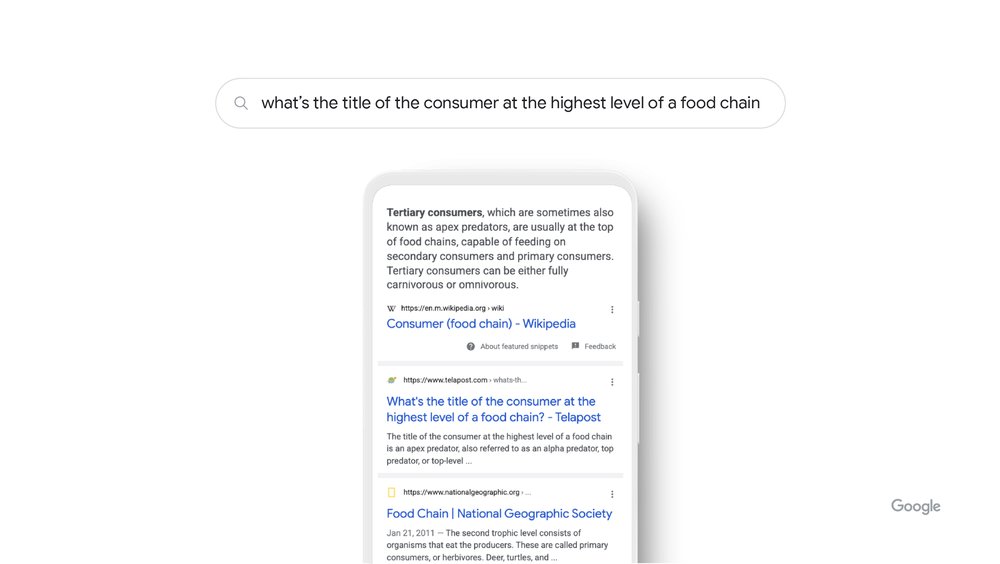

Per spiegare il funzionamento pratico di questo sistema (che può prendere una query ampia e definire meglio come tale query si collega ai concetti del mondo reale) Nayak fa l’esempio della ricerca “qual è il titolo del consumatore al livello più alto di una catena alimentare“: i sistemi di Google imparano vedendo su varie pagine quelle parole che il concetto di catena alimentare può avere a che fare con gli animali, e non con consumatori umani; comprendendo e abbinando queste parole ai loro concetti correlati, RankBrain capisce che l’utente stava cercando ciò che viene comunemente definito un “predatore apicale” e fornisce quindi il risultato più pertinente.

Come suggerisce il nome, RankBrain serve a classificare o decidere l’ordine migliore per i migliori risultati di ricerca e, nonostante l’età avanzata, “continua a essere uno dei principali sistemi di intelligenza artificiale che alimentano la Ricerca oggi”, usato in molte query e in tutte le lingue e regioni.

- Neural matching: un sofisticato motore di recupero

La corrispondenza neurale – neural matching – è stata la successiva AI rilasciata da Google per la ricerca, testata inizialmente nel 2018 e poi estesa ai risultati della ricerca locale nel 2019. Oggi le reti neurali sono oggi alla base di molti moderni sistemi di intelligenza artificiale, e Google ne aveva già intravisto le potenzialità per perfezionare la comprensione di come le query si relazionano alle pagine, valutando anche rappresentazioni più sfocate dei concetti nelle query e nelle pagine.

Nello specifico, la corrispondenza neurale aiuta Google a capire in che modo le query si relazionano alle pagine esaminando l’intera query o il contenuto della pagina (e non solo la stringa di keyword) nel contesto di quella pagina o query, offrendo a Google una comprensione più ampia dei concetti ed espandendo così la quantità di contenuti che Google è in grado di cercare.

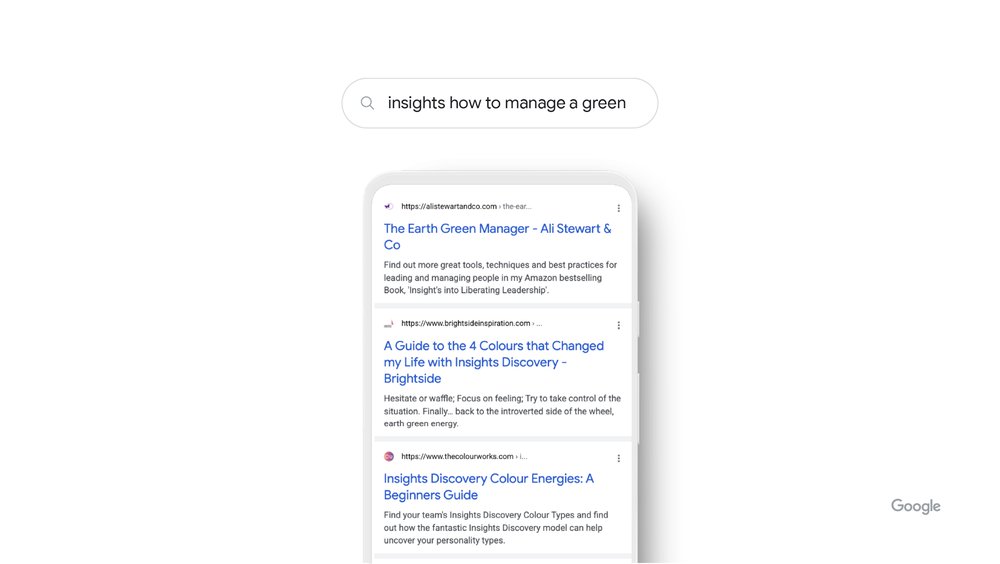

L’esempio chiarificatore è “suggerimenti su come gestire un verde“, che potrebbe suonare strano anche per un essere un umano: grazie all’abbinamento neurale, però, Google ha osservato le rappresentazioni più ampie dei concetti nella query – gestione, leadership, personalità e altro – e decifrato che l’utente sta cercando indicazioni di management relativi a una popolare guida della personalità basata sui colori.

Oggi, il neural matching fa parte dell’algoritmo di ranking, viene utilizzato in molte query – se non nella maggior parte – per tutte le lingue, in tutte le regioni e nella maggior parte dei settori, e aiuta in modo specifico Google a classificare i risultati di ricerca: la comprensione aumentata dei concetti più ampi rappresentati in una query o in una pagina aiuta “a creare un’ampia rete quando eseguiamo la scansione del nostro indice alla ricerca di contenuti che potrebbero essere rilevanti per la tua query”, e quindi la corrispondenza ha un ruolo chiave nel modo in cui Google recupera documenti rilevanti da un flusso di informazioni enorme e in continua evoluzione.

- BERT — un modello per comprendere significato e contesto

È del 2019 il debutto di Bidirectional Encoder Representations form Transformers, o più semplicemente BERT, una tecnologia basata sulla rete neurale per il pre-allenamento dell’elaborazione del linguaggio naturale che ha rappresentato un enorme cambiamento nella comprensione del linguaggio naturale, aiutando Google a capire come le combinazioni di parole esprimono significati e intenti diversi.

Anziché cercare semplicemente un contenuto che corrisponda alle singole parole, BERT comprende come una combinazione di parole esprima un’idea complessa, significati e intenti diversi, capisce le parole in una sequenza e come si relazionano tra loro, prendendo in esame tutte le parole dalla query, anche quelle apparentemente piccole, ma che “possono avere grandi significati” – in pratica, consente a Google di capire come le parole possono cambiare il significato delle query se utilizzate in una sequenza particolare.

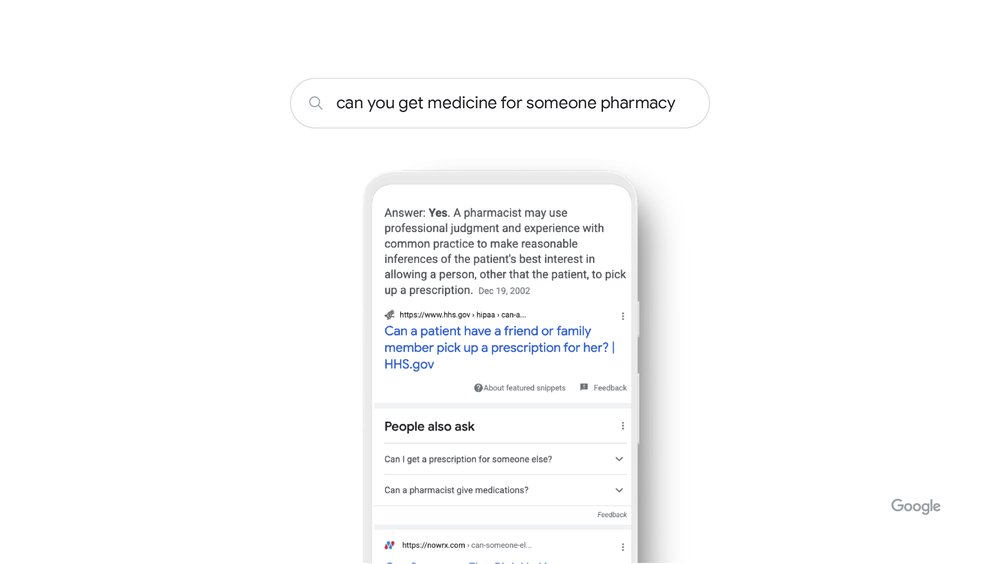

Lanciando la query “puoi prendere medicine per qualcuno farmacia“, BERT capisce che stiamo cercando di capire se possiamo prendere medicine per qualcun altro; prima di questa tecnologia, invece, Google ignorava la preposizione e si limitava a condividere per lo più i risultati su come compilare una prescrizione (come prendere medicine).

Al momento del suo lancio, BERT era utilizzato nel 10% di tutte le query in inglese, ma è stato ampliato a più lingue e presto utilizzato in quasi tutte le query in inglese; oggi è utilizzato nella maggior parte delle query ed è supportato in tutte le lingue.

Secondo Nayak, BERT eccelle “in due dei compiti più importanti nel fornire risultati rilevanti: classifica e recupero“. Sulla base della sua complessa comprensione del linguaggio, BERT può classificare molto rapidamente i documenti per rilevanza, e inoltre la sua formazione ha consentito di migliorare i sistemi legacy, rendendoli più utili nel recupero di documenti rilevanti per la classifica. Eppure, anche BERT non funziona mai da solo ma, come tutti gli altri sistemi, fa parte di un insieme di tecnologie che lavorano insieme per condividere risultati di alta qualità.

- MUM: dal linguaggio alla comprensione delle informazioni

È più recente l’introduzione di Google MUM, tecnologia annunciata nel corso di Google I/O 2021 dello scorso maggio e ultima pietra miliare dell’AI nella Ricerca: mille volte più potente di BERT, MUM è in grado sia di comprendere che di generare linguaggio (quindi può essere utilizzato per comprendere le variazioni di nuovi termini e lingue), è addestrato in 75 lingue e per molti compiti diversi contemporaneamente, e ciò consente di sviluppare una comprensione più completa delle informazioni e della conoscenza del mondo. MUM è anche multimodale, il che significa che può comprendere le informazioni in più modalità come testo, immagini e altro in futuro.

Rispetto ai casi precedenti, Nayak sottolinea che MUM non viene utilizzato per scopi di ranking in questo momento nella Ricerca Google, e quindi non serve a classificare e migliorare la qualità dei risultati di ricerca come invece fanno RankBrain, corrispondenza neurale e sistemi BERT.

Ad ogni modo, questa tecnologia supporta tutte le lingue e le regioni, e Google ha testato parte del suo potenziale per migliorare le ricerche di informazioni sui vaccini COVID-19 e per generare i suggerimenti sugli argomenti correlati nei risultati dei video. Una possibile applicazione futura anticipata dall’articolo è “offrire modi più intuitivi per eseguire ricerche utilizzando una combinazione di testo e immagini in Google Lens”, e il progressivo utilizzo di esperienze basate su MUM in Ricerca permetterà di “passare da una comprensione linguistica avanzata a una comprensione più complessa e articolata delle informazioni sul mondo”.

Le intelligenze artificiali e gli update di Google

Questi sono gli utilizzi principali che Google fa dei sistemi di intelligenza artificiale applicata alle sue SERP, che servono innanzitutto per “comprendere il linguaggio, compresa la query e i risultati potenzialmente rilevanti” e “non sono progettati per agire in isolamento per analizzare solo una query o il contenuto di una pagina”, ma appunto per avere una comprensione generale di entrambi gli aspetti.

E poi ci sono i core update, come ci ricorda Schwart, gli aggiornamenti periodici che servono ad assicurare che i risultati forniti dal motore di ricerca siano sempre pertinenti e di qualità: come rivelato da Google, oltre ai tre grandi meccanismi di AI applicati a Search (RankBrain, corrispondenza neurale e BERT) ci sono infatti “ci sono altri elementi di intelligenza artificiale che possono influire sui core update” su aspetti che non riguardano l’attività di questi tre sistemi, e quindi ci sono contemporaneamente in funzione diversi tipi di AI.

Inoltre, c’è un mondo al di fuori della Ricerca – la ricerca locale, le immagini, lo shopping e altri verticali dell’ecosistema di Big G – in cui sono utilizzati altri tipi di tecnologie, separati e specializzati.

Cosa significano questi sistemi AI per la SEO

Sapere che l’intelligenza artificiale è sempre più centrale per Google e per la Ricerca non deve spaventarci sul possibile futuro della SEO – e non solo perché già in tempi non sospetti John Mueller ci rassicurava sul fatto che “la SEO non diventerà obsoleta nonostante AI e machine learning”.

Questi sistemi, infatti, servono principalmente a migliorare il modo in cui Google stesso capisce le query e i contenuti dei siti per un matching perfetto dell’intent dell’utente, e in definitiva avvicina il motore di ricerca a parlare la nostra stessa lingua. Questo in realtà dovrebbe favorire il nostro lavoro nella creazione dei contenuti, ricordando il primo consiglio pratico per il SEO copywriting, ovvero di “scrivere per gli esseri umani”: se intercettiamo il search intent che sottosta alla query e se le persone comprendono ciò che scriviamo, anche gli algoritmi e le intelligenze artificiali lo comprenderanno e premieranno le pagine con giusto ranking.

E quindi, anche se non ci sono tecniche di ottimizzazione SEO per BERT o per le altre AI, vale comunque tutto il lavoro classico che facciamo per migliorare i nostri siti e le nostre pagine, sia a livello di contenuto che sul fronte tecnico.